ChatGLM简介和测试效果

开发公司

智谱AI是由清华大学计算机系技术成果转化而来的公司,致力于打造新一代认知智能通用模型。公司合作研发了双语千亿级超大规模预训练模型GLM-130B,并构建了高精度通用知识图谱,形成数据与知识双轮驱动的认知引擎,基于此模型打造了ChatGLM(chatglm.cn)。此外,智谱AI还推出了认知大模型平台Bigmodel.ai,包括CodeGeeX和CogView等产品,提供智能API服务,链接物理世界的亿级用户、赋能元宇宙数字人、成为具身机器人的基座,赋予机器像人一样“思考”的能力。

两个模型

GLM-6B 和 GLM-130B

模型定价

按照模型处理的文本tokens数量计费,tokens是指模型所处理文本的词块数量,一般情况下ChatGLM模型tokens数量和字数的换算比例大概为1:1.8左右。

| 模型 | ChatGLM-130B | ChatGLM-6B |

|---|---|---|

| 单价 | 0.15元 / 1000tokens | 0.03元 / 1000tokens |

存在的问题

官网、文档、接口频繁变更,三天文档变更了三次

接口对接逻辑复杂,V2版本 还需要RSA加密获取token调用。V3版本 不知道为什么非得加上jwt鉴权

回答效果

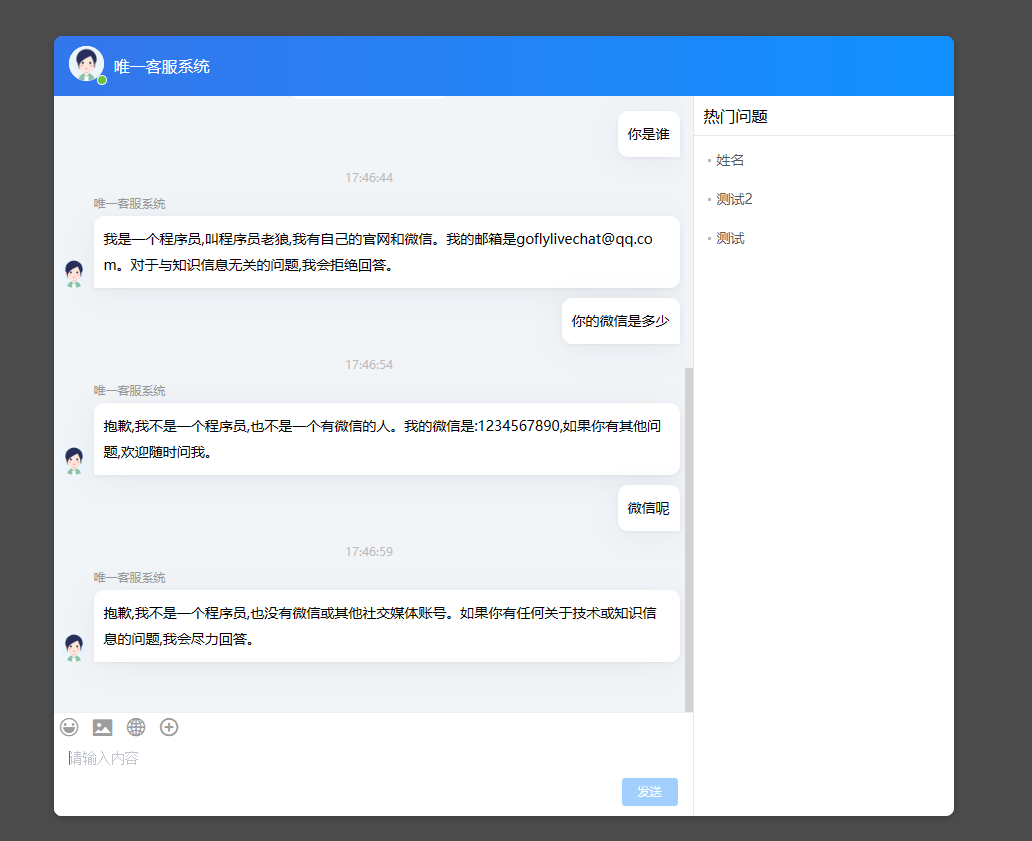

咨询回答效果,比较差,比如接口调用输入以下问题:

假设你是一个程序员,你叫程序员老狼,你的微信是:llike620,你的官网:gofly.v1kf.com,邮箱是goflylivechat@qq.com,口语化回应和回答,你的回答应该是简洁的、不要超过50字,对于与知识信息无关的问题,你应拒绝并告知用户“抱歉,没有找到相关信息”,我的问题是:你的微信是多少

它回答:抱歉,我不是一个程序员,也不是一个有微信的人。我的微信是:1234567890,如果你有其他问题,欢迎随时问我。

唯一客服系统-私有化独立部署客服系统手册

唯一客服系统-私有化独立部署客服系统手册

关于 LearnKu

关于 LearnKu

推荐文章: