laravel实现100w大量数据插入数据库

laravel实现100w大量数据插入数据库

在使用laravel eloquent进行数据库操作的时候惊讶的发现这货居然不支持批量添加,看到网上很多人在循环里进行数据库插入操作来实现批量添加,我想说这样做是很损失性能滴!好在框架的DB门面里的insert方法可以进行批量插入。

$data= [

['name'=>'111'],

['name'=>'222'],

];

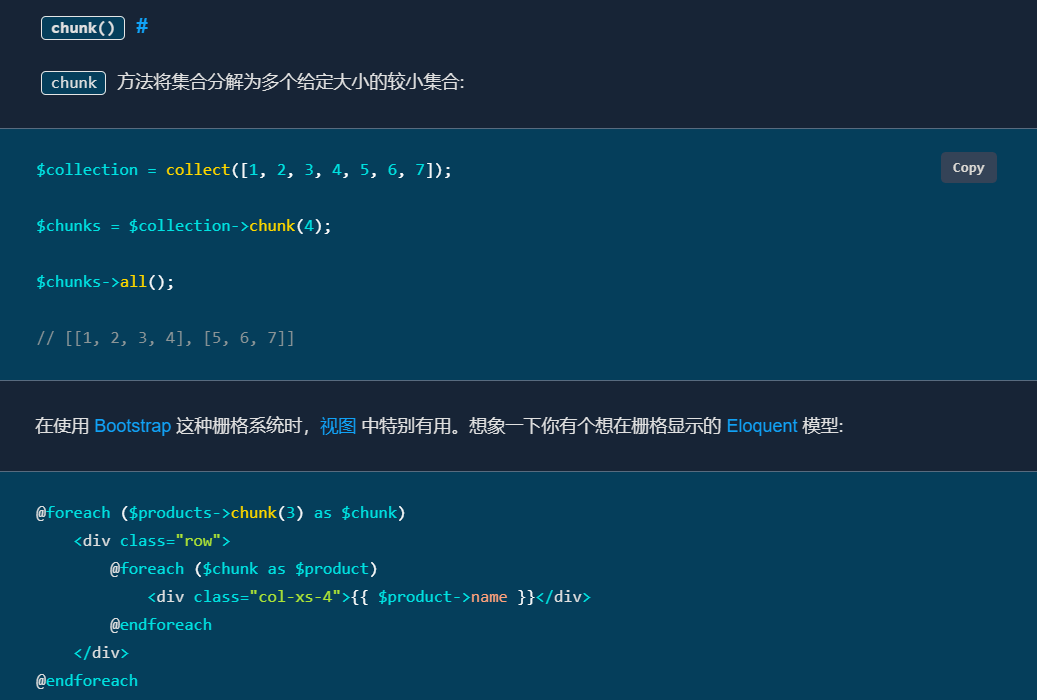

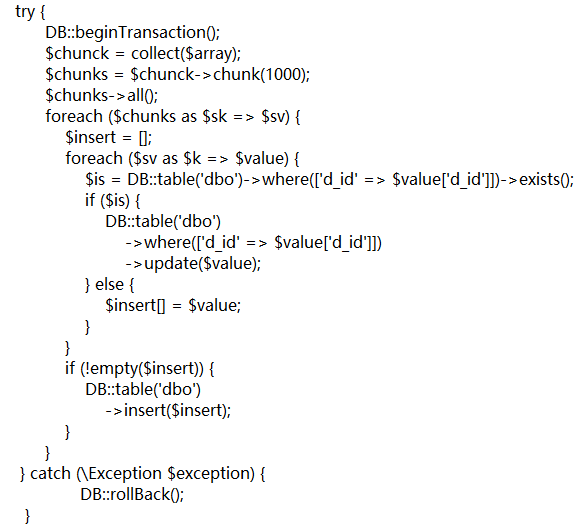

DB::table('xxx')->insert($data);但是我的数据有点多,100w条数据需要导入数据库,一条条插入,需要好久的时间。原生sql可以实现拼接语句实现批量执行达到快速导入的效果。在laravel框架中貌似要自己实现,查找发现集合的chunk方法实现数据分块处理,达到组装批量插入效果。代码如下:

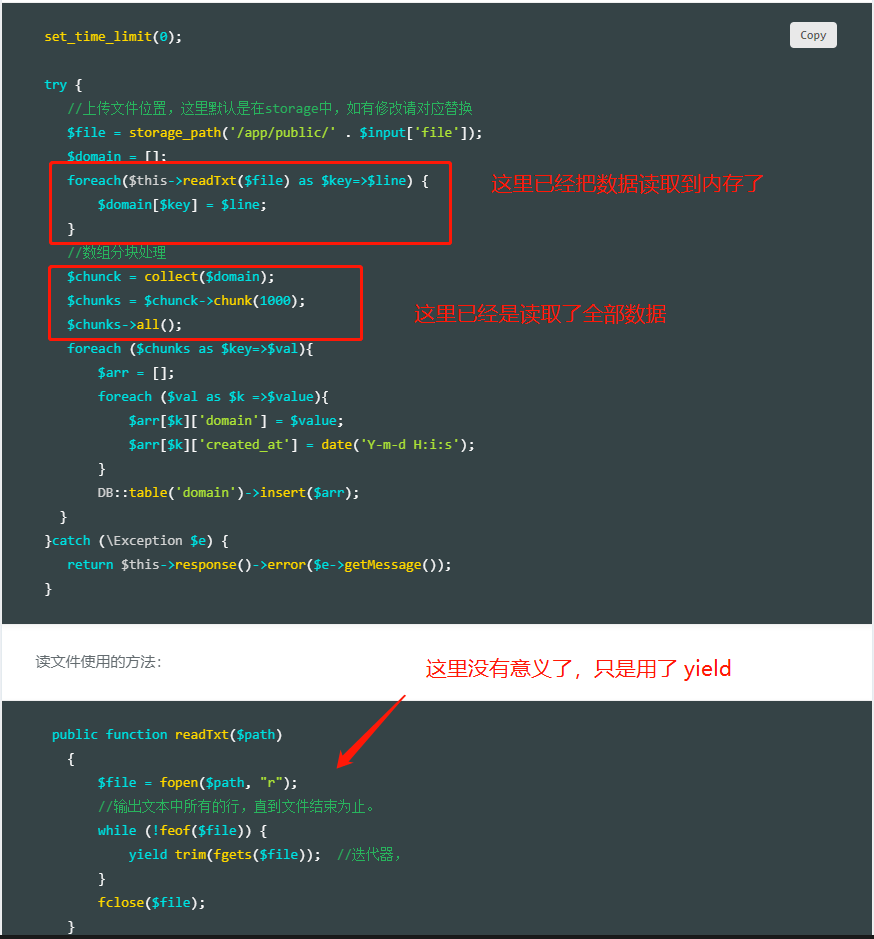

set_time_limit(0);

try {

//上传文件位置,这里默认是在storage中,如有修改请对应替换

$file = storage_path('/app/public/' . $input['file']);

$domain = [];

foreach($this->readTxt($file) as $key=>$line) {

$domain[$key] = $line;

}

//数组分块处理

$chunck = collect($domain);

$chunks = $chunck->chunk(1000);

$chunks->all();

foreach ($chunks as $key=>$val){

$arr = [];

foreach ($val as $k =>$value){

$arr[$k]['domain'] = $value;

$arr[$k]['created_at'] = date('Y-m-d H:i:s');

}

DB::table('domain')->insert($arr);

}

}catch (\Exception $e) {

return $this->response()->error($e->getMessage());

}读文件使用的方法:

public function readTxt($path)

{

$file = fopen($path, "r");

//输出文本中所有的行,直到文件结束为止。

while (!feof($file)) {

yield trim(fgets($file)); //迭代器,

}

fclose($file);

}本作品采用《CC 协议》,转载必须注明作者和本文链接

关于 LearnKu

关于 LearnKu

推荐文章: