MySQL减轻批量插入压力的,这种方案是否可行?

场景

在线答题的系统,每个用户每次开始一次考试的题目列表大概是在100~150道题目之间。

现在的做法是,用户开始考试就会创建一条exam_record的记录,每答一道题目就会提交一条exam_record_detail的记录,考试中还存在修改答案(写入或者修改行数据)。

现状

- 项目运行了2个月左右,由于exam_record_detail表没有做水平分表,现在大概有26W条数据。

- 在一个备考高峰时期,有不少用户反映存在卡顿的感觉。

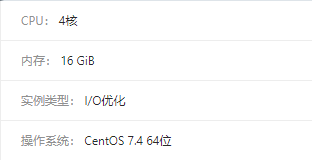

- 服务器配置

带宽20Mb,单机配置

由于没做监控,所以现在也不知道具体瓶颈是在哪个地方。后知后觉上阿里云查看监控,才发现日志文件已经过期(看不到具体瓶颈是在磁盘IO上还是带宽上)

现在查看了数据库,大概在当天10~11点的高峰时期,exam_record 1700条记录,exam_record_detail 上面新增了3.6W条记录。

项目初期上线得急,很多东西都直接做了查库,匆匆忙忙就上线了本人也很无奈,(话语权不够)。

现有疑虑

- 感觉写入数据量也不多,所以实际上感受到卡顿是来源查询上面的压力?

关于 LearnKu

关于 LearnKu

推荐文章: